Ik maak computer vision ml modellen met yolo objectdetectie

Over deze dienst

Automatische vertaling

Machine Learning Engineer met 4 maanden professionele ervaring in het bouwen van productieklare computer vision en ML systemen. Ik ben gespecialiseerd in YOLO objectdetectie, instance segmentation en het inzetten van modellen die werken onder echte omstandigheden.

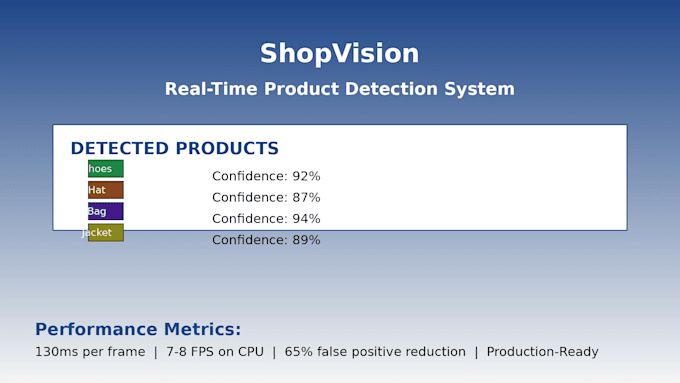

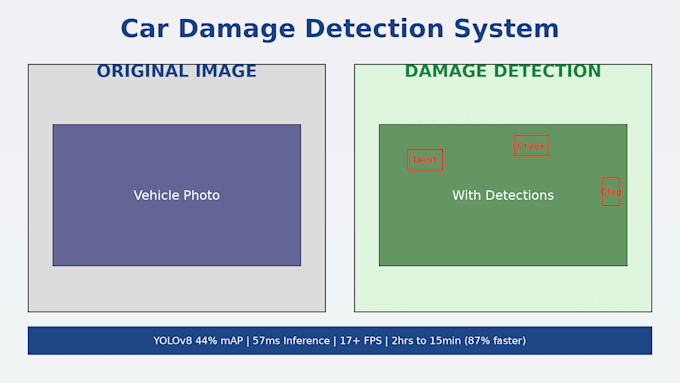

Recente successen: Een realtime productdetectiesysteem gebouwd dat live searches bedient, een systeem voor autoschadeherkenning ontwikkeld dat handmatige beoordeling van 2 uur tot 15 minuten reduceert, en een fraudedetectie-pipeline ingezet die meer dan 45.000 verdachte claims identificeert.

Ik lever complete oplossingen: modeltraining, productieoptimalisatie (40% latency vermindering), FastAPI deployment, Docker containerisatie en database-integratie. Elk project bevat prestatiegegevens, broncode en documentatie.

Of je nu objectdetectie, beeldclassificatie, fraudedetectie of een volledige ML-pipeline nodig hebt, ik bouw systemen die meegroeien. Laten we jouw data omzetten in slimme oplossingen.

Maak kennis met Ahmed Dridi

Full Stack AI Developer

- Afkomstig uitTunesië

- Lid sindsokt 2025

- Gem. reactietijd1 uur

Talen

Engels

Automatische vertaling

Mijn portfolio

Veelgestelde vragen

Automatische vertaling

In welk formaat moet ik mijn dataset aanleveren?

Ik accepteer datasets in alle gangbare formaten: afbeeldingen in mappen (JPG, PNG), COCO-formaat, Pascal VOC of zelfs ruwe afbeeldingen in een ZIP-bestand. Als je data niet gelabeld is, kan ik je begeleiden bij annotatietools (Roboflow, Label Studio, CVAT). Voor de beste resultaten lever je bij voorkeur 200-500 afbeeldingen per categorie, hoewel ik

Hoe lang duurt het trainen van het model?

Trainingstijd hangt af van de datasetgrootte en hardware. Typische tijdlijnen: 500 afbeeldingen = 2-3 dagen, 1000+ afbeeldingen = 5-7 dagen. Grotere datasets kunnen langer duren. Ik geef altijd een op maat gemaakte planning na beoordeling van je dataset. Opmerking: Fiverr levertijden (7/10/14 dagen) omvatten training, optimalisatie en deploy.

Werkt mijn model op echte data buiten mijn trainingsset?

Ja, dat is het doel. Ik optimaliseer modellen specifiek voor prestaties in de echte wereld met technieken zoals data augmentation, temporele filtering en confidence thresholding. Mijn modellen worden getest op generalisatie. Als je testdata echter sterk afwijkt van je trainingsdata (bijvoorbeeld in belichting), kan de prestaties variëren.

Wat als de nauwkeurigheid van het model niet goed genoeg is?

Ik streef naar goede resultaten. Als de nauwkeurigheid onder de verwachtingen ligt, diagnoseer ik het probleem—meestal ligt het aan datasetkwaliteit, klasse-imbalans of onvoldoende data. Ik stel oplossingen voor: meer trainingsdata, data augmentation, hyperparameter tuning of een andere architectuur proberen. Extra iteraties kunnen nodig zijn.